29 条 Prompt 设计经验

大模型输出不满意、瞎编、不按要求来?核心问题在 Prompt 设计!这份实战经验涵盖内容生成、打标签、风控分析、AI Coding 等场景,揭秘 “对抗式收敛”“精准约束” 等核心方法,从边界定义到结构设计,帮你搞定大模型沟通难题。

最近工作中做了大量调用大模型生成内容、打标签、评估、调优 prompt 工作,复盘记录下过程中的一些经验和踩坑。

平常大家说的模型输出内容不满意、模型在瞎编、不按要求输出、不听话。。。往往都是提示词设置的不合理导致的。需要通过设计合适的 prompt,引导大模型输出合理的内容,输出结果的质量很大程度取决于提示模型的能力。

在开始之前,推荐两篇文章,可以了解基本概念、基本框架、常见技巧,下文我的经验是在这些技巧的基础上,结合工作中 prompt 设计的总结。

– 万字长文解码如何玩转Prompt(附实践应用) 这篇来自“淘宝大技术”,大概是我最近一年多看到关于 prompt 写的最好的一篇。

– https://platform.openai.com/docs/guides/prompt-engineering 这个链接来自 OpenAI 官方关于提示词技能的描述。

01 工作应用

1、prompt 不是“一次写完”,而是“对抗式收敛”,写一版 → 评估 → 发现问题 → 调优 → 评估 → 发现问题 → 调优,不断进行,这是整体思路。

2、和大模型沟通结尾处可以添加上这一句:你看看是否还有其他信息需要我确认或补充的。

– 设计逻辑:这就像工作中一样,老板开会结束后通常都会问这么一句,来确保大家信息是对齐的,我们和大模型的关系也同样。

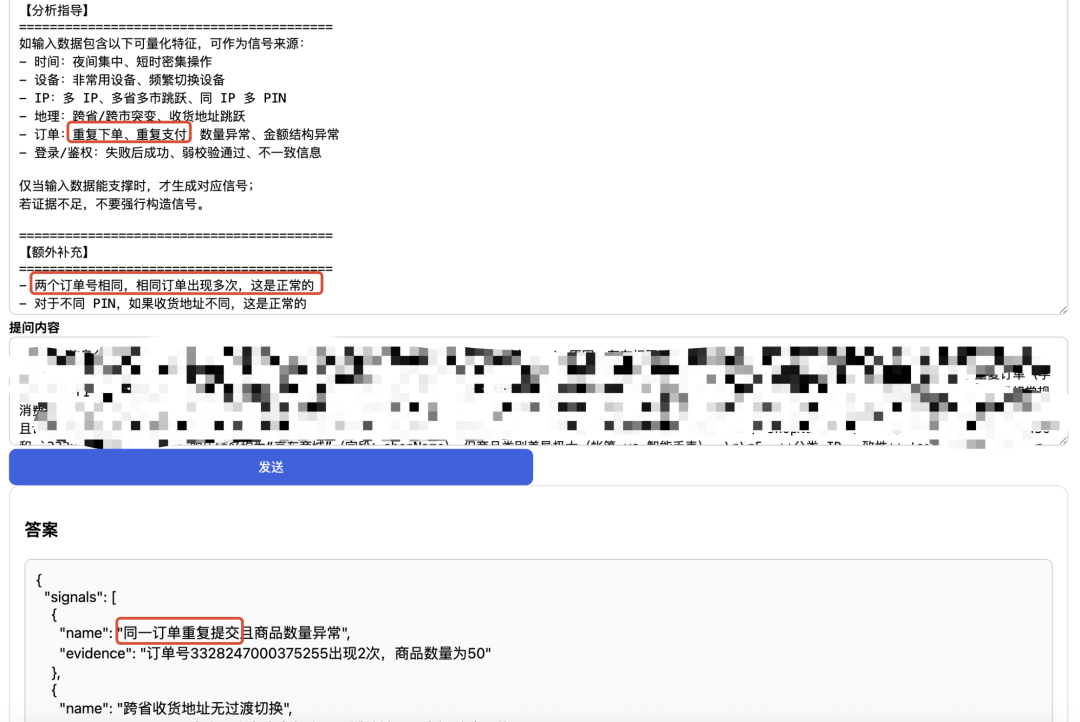

3、prompt 差一点,结果都差异很大。

– 用大模型分析风险,标出异常风险信号,先用 GPT 写的一版 prompt,一直会把重复订单判定为异常信号。

– 但因为用户可能会重复来客诉、推数重复、数据清洗不干净等原因,所以重复订单是正常的,我在 prompt 中额外补充了这句“两个订单号相同,相同订单号出现多次,这是正常的”,依然会将重复订单判定为异常信号。

– 让 GPT 分析一版,发现前面做了强要求。

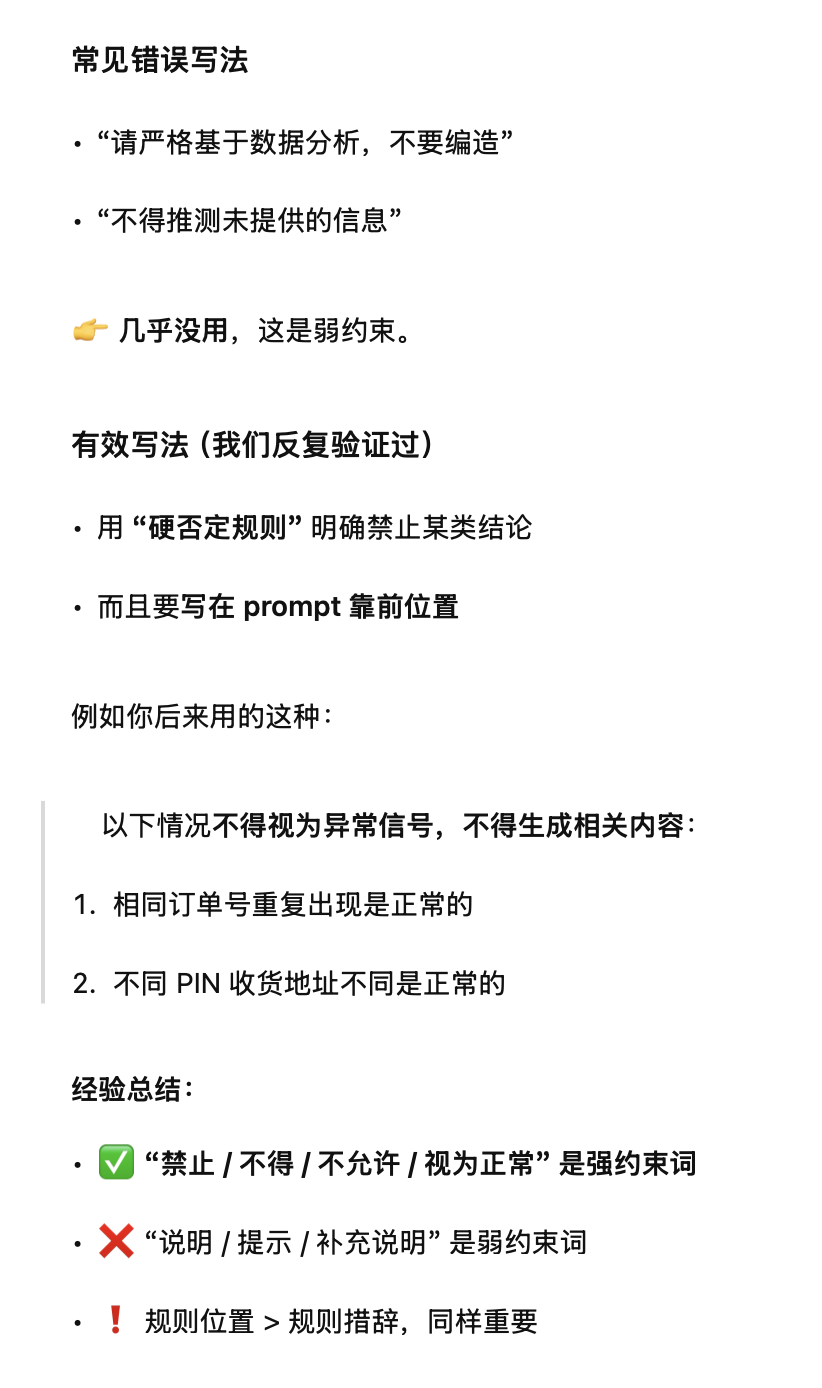

– 经验:标题取“额外补充”太软了,对大模型来说优先级很低,需要改为“严格执行”,并且把顺序放到 prompt 靠前的位置。

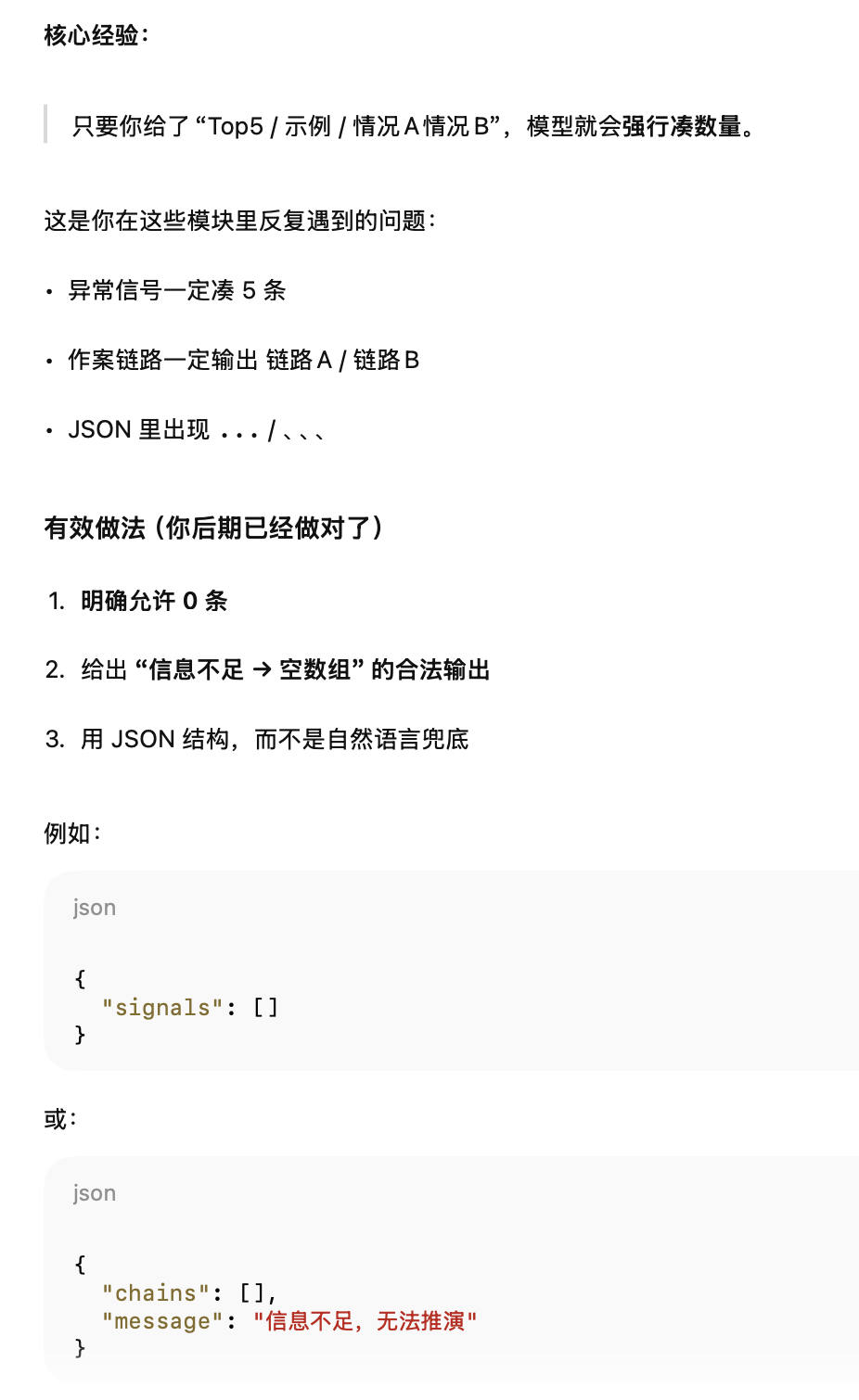

4、让大模型打标签,prompt 设计时,需要同时保证准确率和泛化能力,所以设计逻辑应该是:清晰的骨架 + 少量的示例。

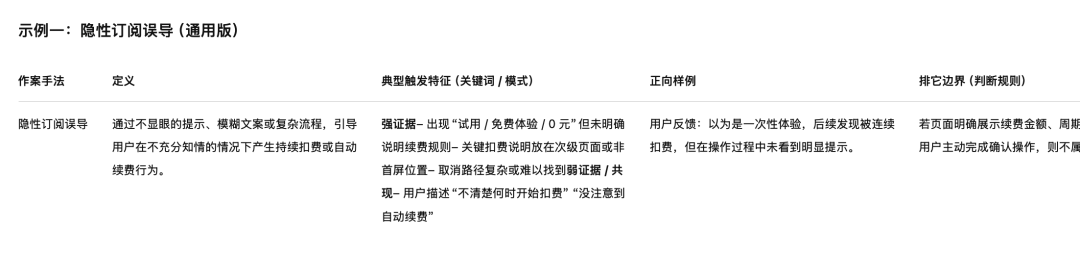

– 实际案例:此前我用大模型给客诉打作案手法的标签,准确率一直无法提升到满意,所以不断调 prompt,越写越复杂看起来像是一堆 if-else、条件之间存在冲突、缺乏泛化能力,经过多轮调优,对样本的准确率达到非常高了,但泛化能力极差,换一批样本准确率马上下降,所以后面换了 prompt 设计思路,改为“清晰的骨架 + 少量的示例、边界条件”,才能同时达到比较高的准确率和泛化能力。

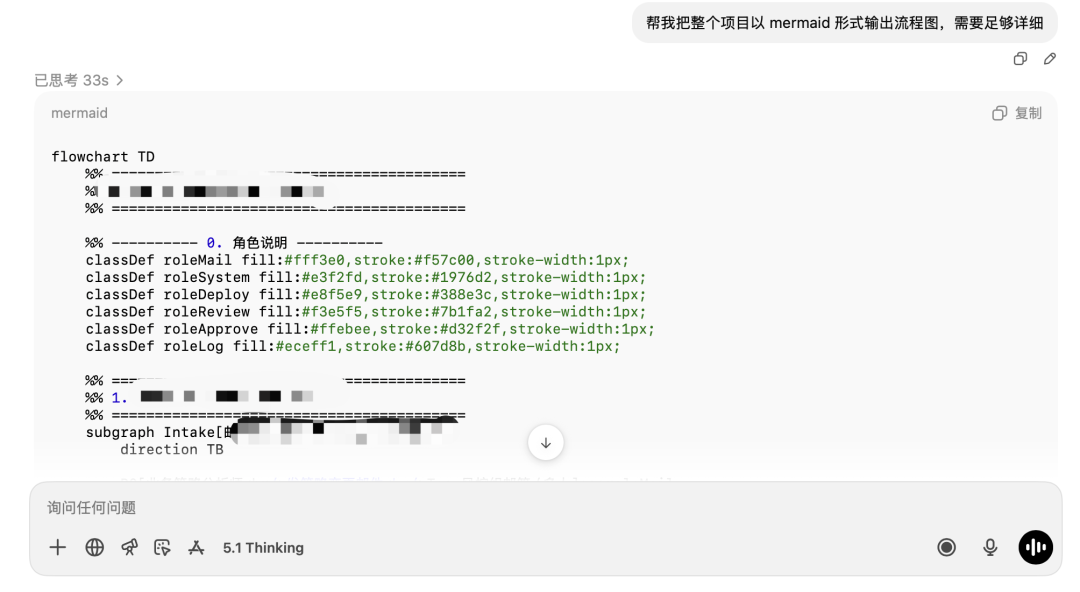

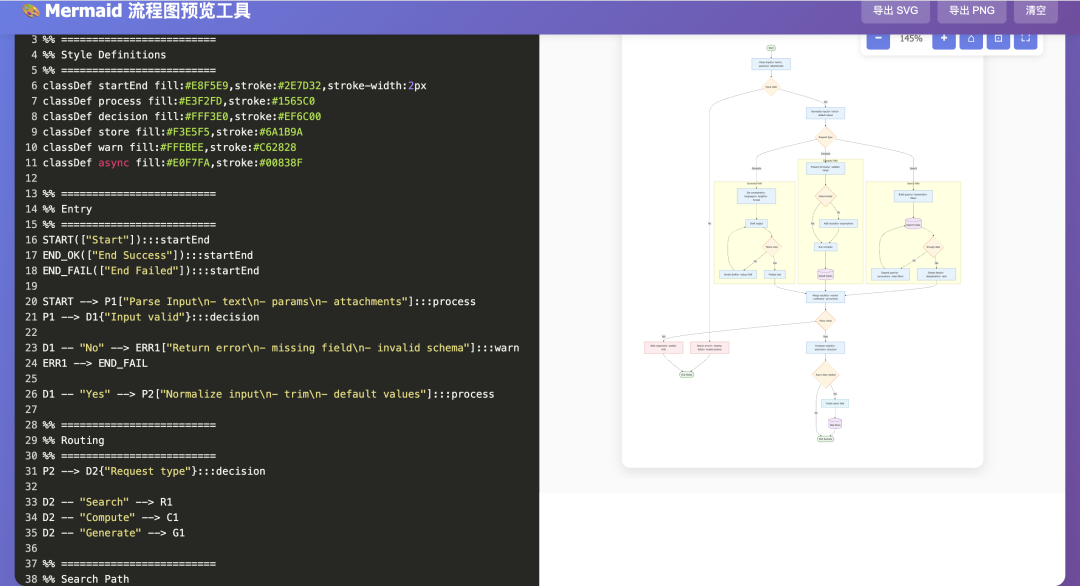

5、prompt:帮我把整个项目以 mermaid 形式输出流程图,需要足够详细。

– 应用场景:针对同一个项目和 GPT 在同一个窗口有大量的沟通,他对项目几乎完全理解。先让大模型输出 mermaid 格式流程图,再通过 mermaid 渲染工具渲染成可视化,并下载到本地(下图缩小了很多倍,做了模糊化处理)。

6、对于大项目,可以在 prompt 中补充完整项目背景,效果会好很多。

– 因为整个链路很多环节会调大模型,但对大模型来说,每个环节是割裂的,它只知道当前这个环节。

– 给它补充一些整个项目的背景、环节链路,它在做它自己那个环节时,也更能体会到应该如何做。

– 和老板派活类似,得讲清楚项目背景、整个项目框架。

7、prompt:根据我们讨论的需求,你写一版 prompt,我让 Cursor 帮我把这个页面绘制出来。

– 应用场景:对于前端页面,与 GPT 讨论需求,GPT 给了很多建议,以及出了多版方案,让 GPT 将方案写成 prompt,再应用 Cursor、Gemini、Trae 等 AI Coding 工具可视化的开发出来。

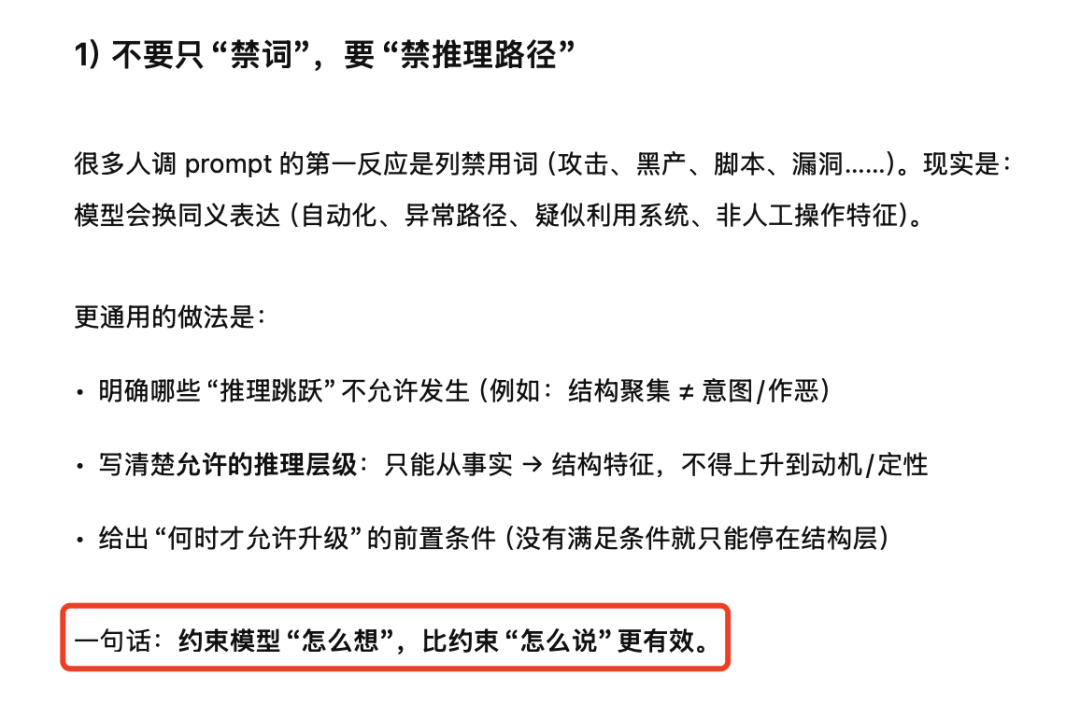

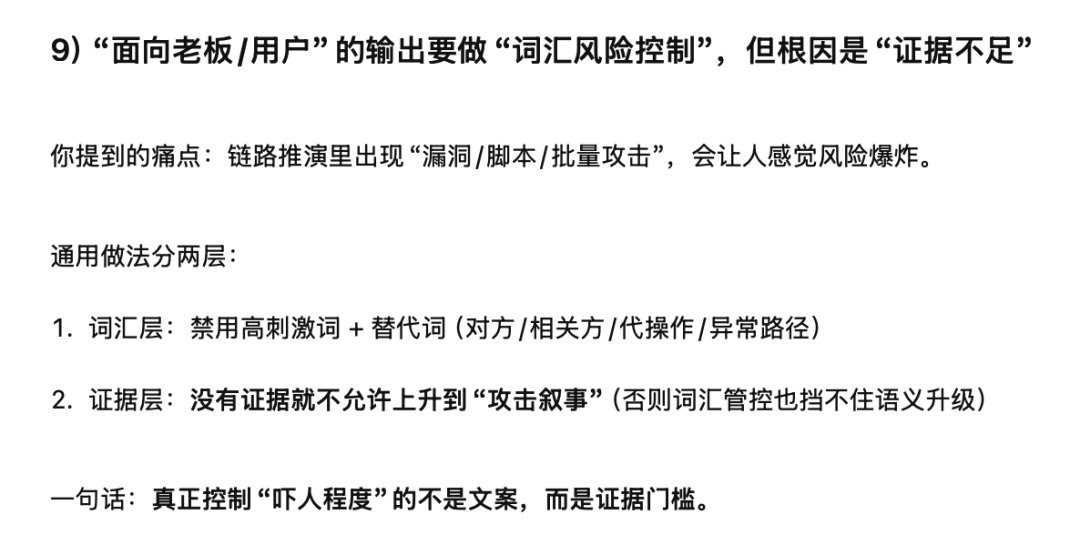

8、prompt 中约束模型“怎么想”,比约束“怎么说”更有效。下方“词汇层”就是在约束“怎么说”,“证据层”就是在约束“怎么想”。

9、prompt 中的示例是“双刃剑”:给得越具体,模型越会“照抄行为”。大模型非常容易去模仿示例的具体内容,而不只是示例的结构。

10、prompt 中设置强边界性逻辑,不同词,大模型执行程度不一样,顺序前后,执行程度也不一样。例如将标题设置为“额外补充”,大模型很可能会忽略,但设置为“必须执行”,基本不会被忽略。

– 实践样例 1:调用大模型做风控分析时,他会可能会把数据缺失判断为黑产故意绕过风控,但对业务来说数据缺失是非常正常现象,决不能等同于故意绕过风控。我已经把这个信息告知大模型,但他依然会判断为黑产故意绕过,经过不断调试,把标题改为“必须执行”,并且把这段 prompt 的位置移动到比较靠前,他才会准确判断。

– 实践样例 2:同一个账号,可能会有多个订单,订单的手机号、收货地址都是相同的,这才是正常现象,不同反倒是有风险,但大模型可能会将这些信息相同,判定为存在聚集,需要通过 prompt 告知大模型这是正常业务逻辑,也需要用前面的严格限制的逻辑。

11、prompt 的“目标”模块尽量中性表达,否则大模型会为了达成目标,找一些很牵强的理由,甚至杜撰理由。

12、如果模型存在多层调用,上一层产生的结论用于下一层继续推理。那上一层的评估标准需要注意,这不是给人看的,是为了下一层推理应用的,所以在设计 prompt 的时候应该按照“原材料层”的逻辑去设计,会更结构特征、证据列表、缺证说明、可复用的中性结论,而不是着重推理出结论、把故事讲完整。

13、对于生成复杂内容,例如一份风险报告,(不考虑调用成本的前提下)可以多次调用,每次生成单个模块,这样生成的内容更具有可评估性。

14、对于输出限制,可以限定输出结构,eg:json,前端页面所需字段可从 json 中精准取到对应字段,例如 Title、content、evidence、priority,就可以让大模型精细化输出前端页面所需信息,而不只是一大段文本。

15、大模型“乱猜”几乎从来不是因为它不听话,而是因为 prompt 没明确告诉它哪些推断是被允许的,哪些是被禁止的。

16、不要让模型“自己决定要输出多少内容”。只要 prompt 中不提供“合法的 0 结果结构”,模型大概率会“编一个”。对模型来说:“输出空数组”比“什么都不说”安全得多。

17、让大模型打标签时,最好需要按照下面逻辑设计 prompt,定义、正向出发逻辑、正向样例、负向排它边界(我们实际应用的这个框架,下图是让 GPT 按框架生成的样例)。

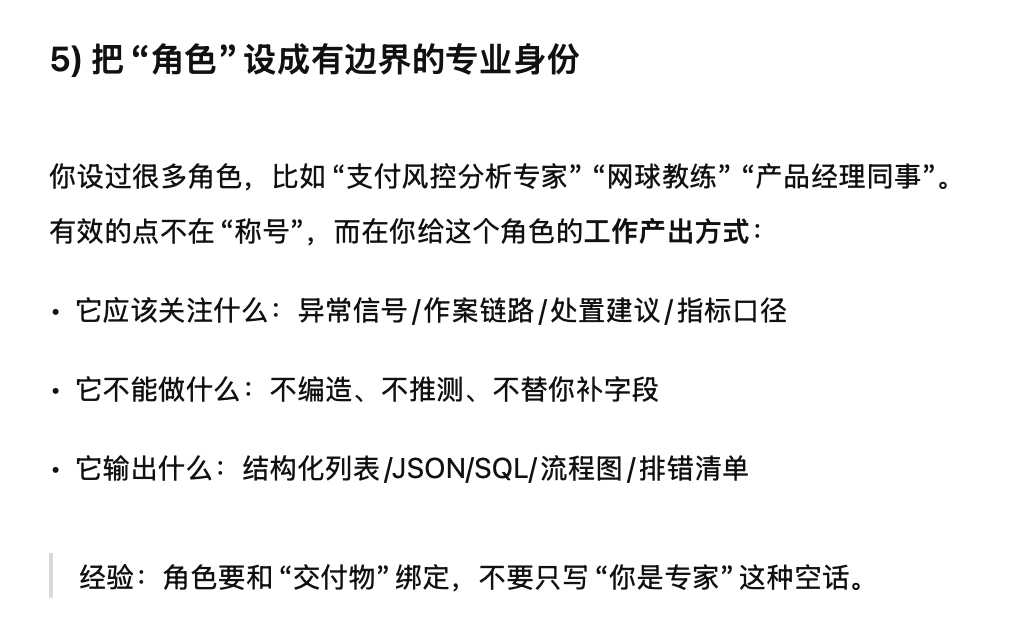

18、角色设定的逻辑,有效的点在于他应该关注什么、不能做什么、输出什么。

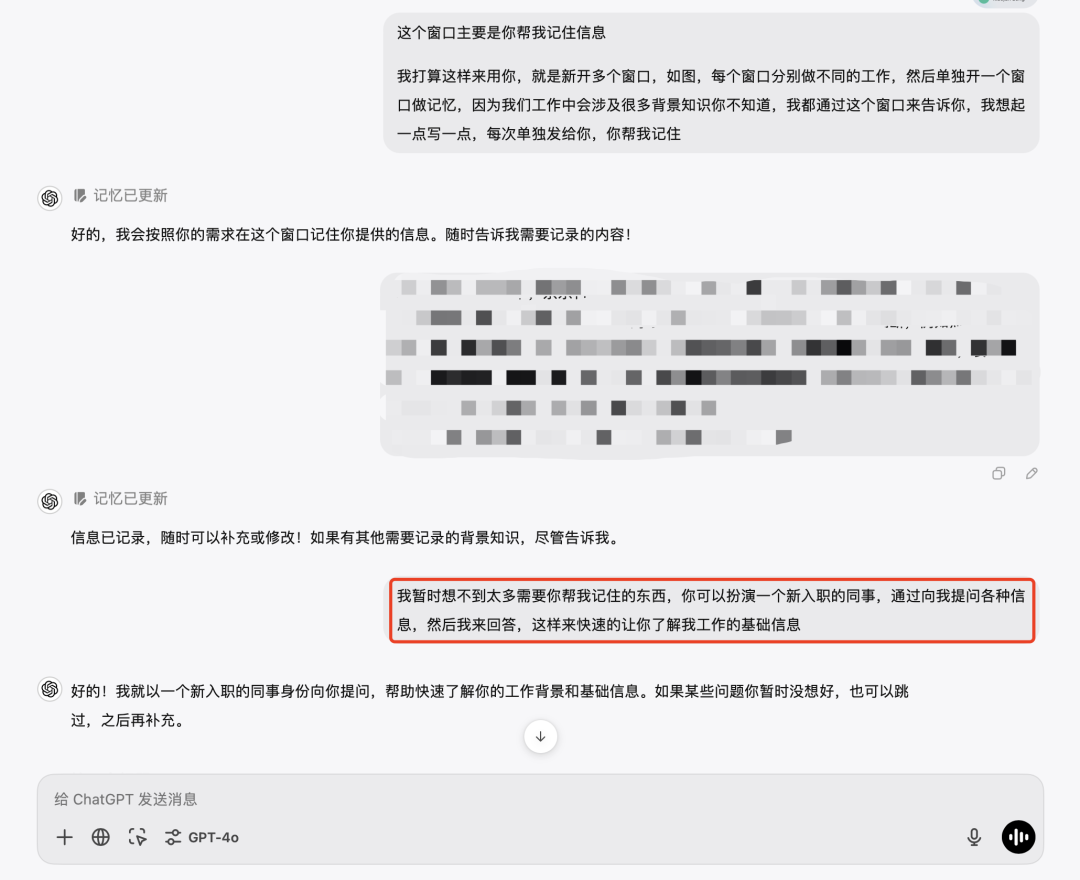

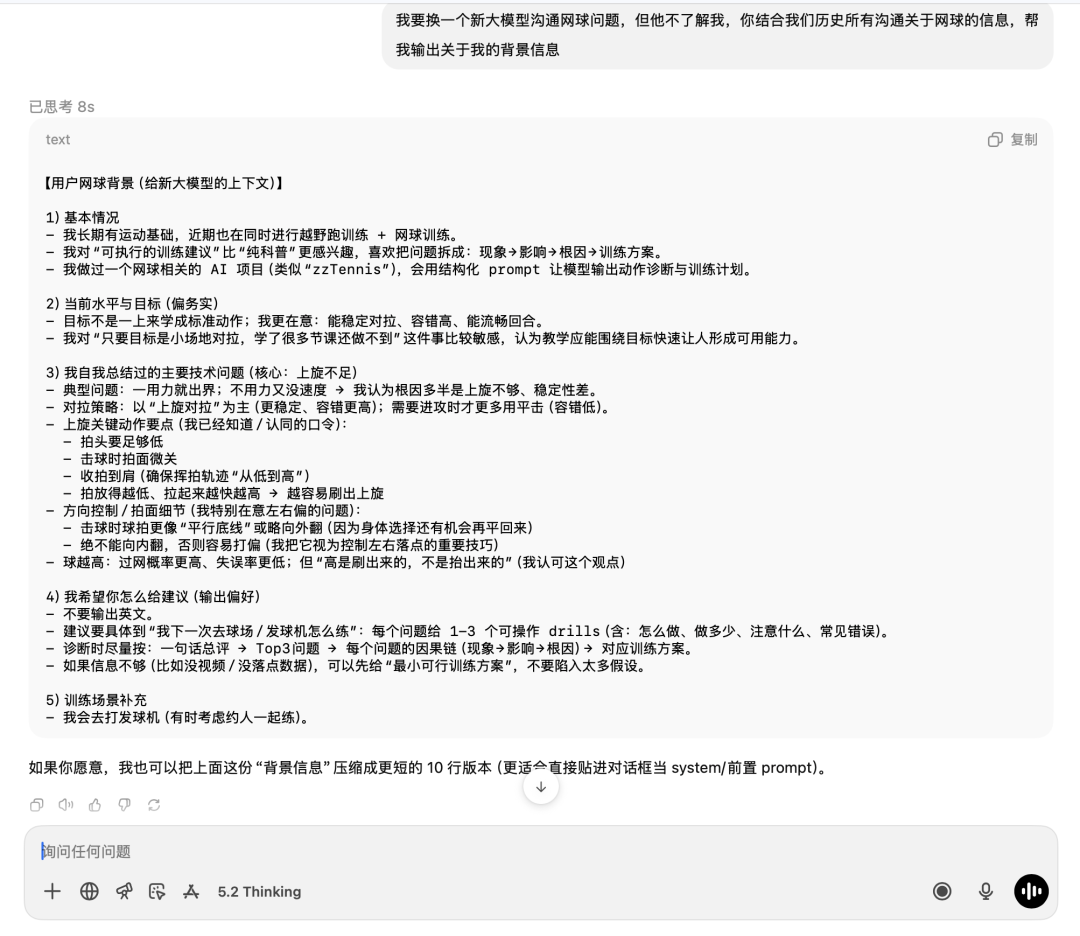

19、prompt:扮演一个新入职的同事,通过向我提问各种信息,然后我来回答,你这样来快速了解我的工作基础信息。

– 应用场景:换到一个新大模型时,它了解通用知识,但不了解我,让大模型扮演入职同事、记者、传记作者等,结构化提问,快速了解背景信息,或者让常用的一个大模型来输出这个背景信息。

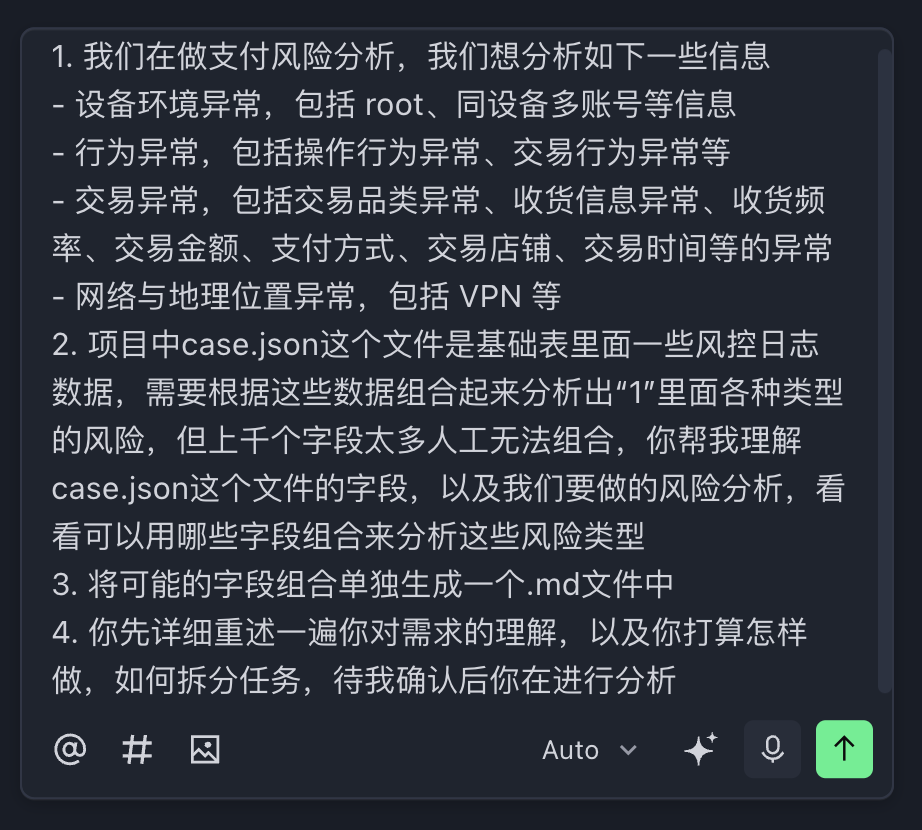

20、将风控日志送入大模型,推理分析可能的风险,如下是早期构造的 prompt。实测,效果较差,还是需要先经过大量工程加工,人工拆分环节,然后每个环节再让大模型介入进来推理分析,这样效果会好很多。

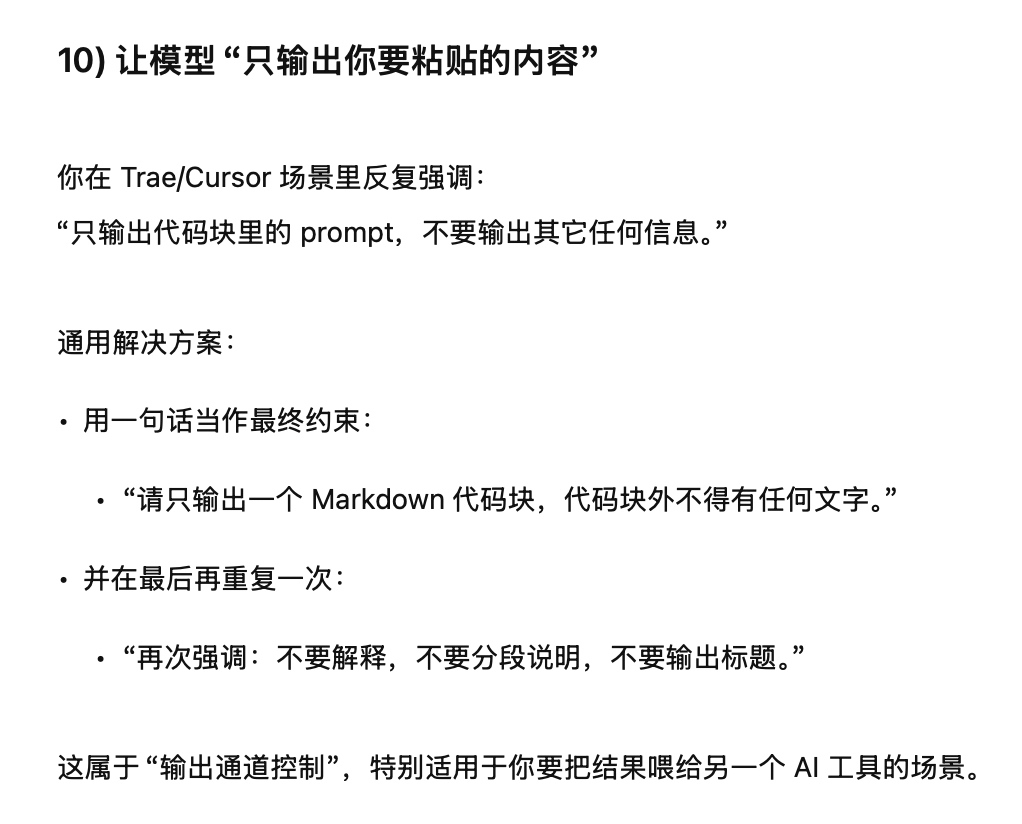

21、让模型“只输出你要粘贴的内容”,可以用以下两句限制。- 用一句话当作最终约束:“请只输出一个 Markdown 代码块,代码块外不得有任何文字。”- 并在最后再重复一次:“再次强调:不要解释,不要分段说明,不要输出标题。”

22、来自“淘宝大技术”的一段 prompt,prompt 中增加情感威胁,实测,对 2025 年 12 月当前的 GPT、Gemini 来说,基本没用,甚至可能起反作用,更有效的设计逻辑是给出思考步骤、限定思考方向。

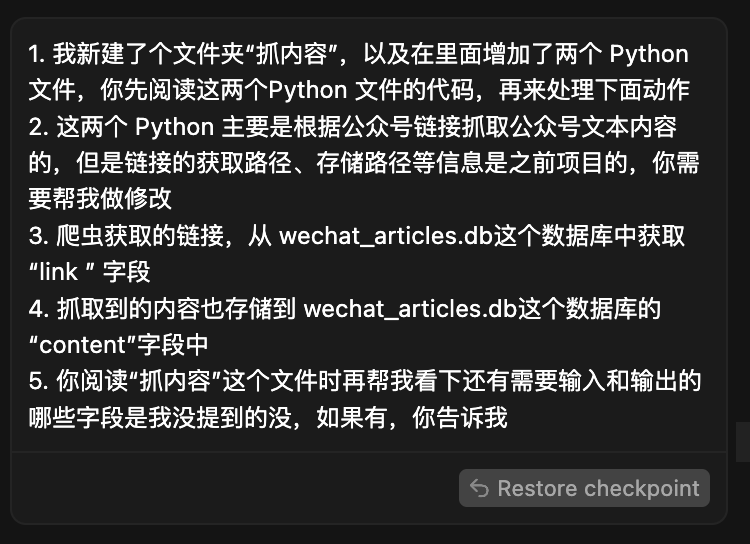

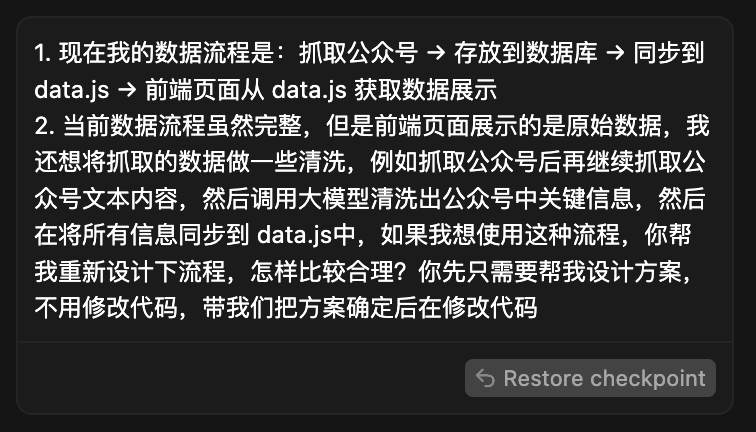

02 AI Coding

23、AI Coding 常用 prompt:你完整阅读一遍代码,并理解这个项目。

– 应用场景:对于打开历史项目,新开对话框,大模型不了解这个项目时,让他快速理解整个项目的逻辑。

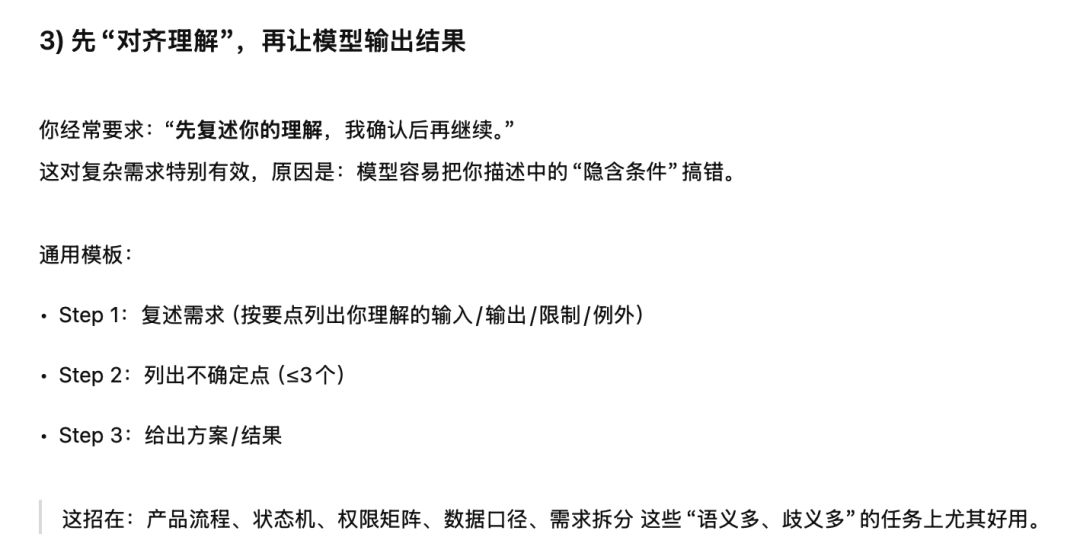

24、AI Coding 常用 prompt:你先完整重述一遍你对需求的理解,以及打算如何改,先不要修改代码,待我确定你理解正确后,你再来修改。

– 应用场景:当项目比较复杂,且我新让它改动的需求点也比较复杂,我不确定我的表述大模型一定完全理解正确时,会用这句 prompt,先“对齐理解”,以及确保改动方案符合预期。还有个好处是它会创建 task 概念,先把要改动的任务点列出来,然后逐步完成,确保不遗漏,如果未全部列出任务,它在实际工作时,做到后面可能就忘掉前面需求了。

25、用 AI Coding 工具将常用工具写成 html 文件,如图二,是一个 mermaid 渲染工具的测试样例。

25、用 AI Coding 工具将常用工具写成 html 文件,如图二,是一个 mermaid 渲染工具的测试样例。

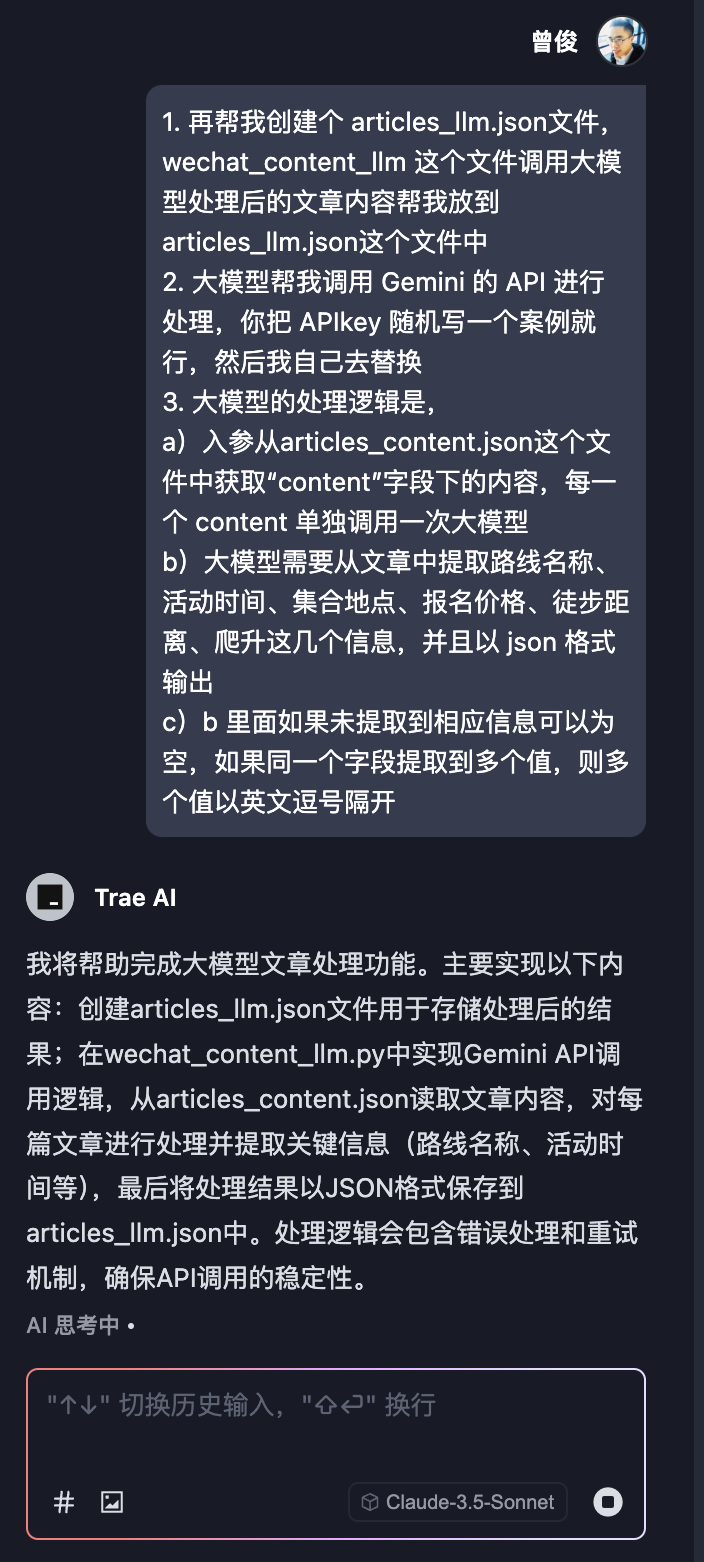

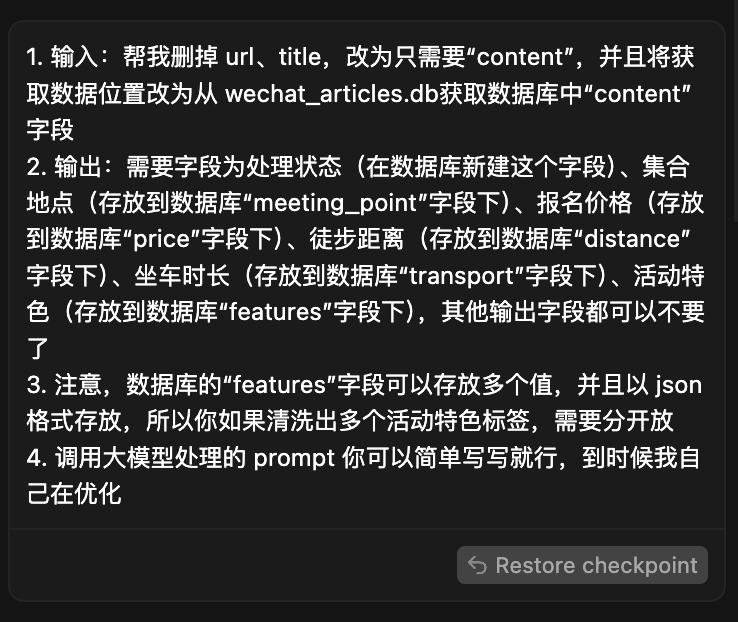

26、对于 AI Coding 工具,prompt 核心逻辑是把需求写得足够清晰,如下图。

27、避免大模型偷懒的 prompt,如下图。因为 AI Coding 沟通需求时,大模型常说,“我要去阅读 xxx 代码,然后做 xxx 修改”,但实际上经常把代码只读了一半就开始修改代码了。

03 个人应用

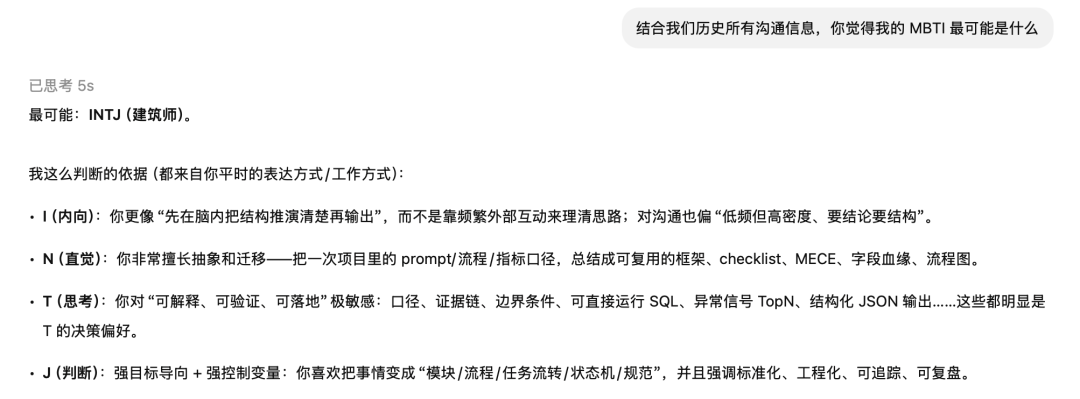

28、prompt:结合我们历史所有沟通信息,你觉得我的 MBTI 最可能是什么。

– 应用场景:与 GPT 有大量历史对话,它足够了解你。

29、prompt:请根据你对我的记忆,有哪些事情是我自己意识不到的,但是如果明白了就能改变我的生活的残酷真相?请坦诚告诉我,以完全客观性的战略深度审视我的情况。

本文由人人都是产品经理作者【曾俊笔记】,微信公众号:【曾俊笔记】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益