拒绝“人工智障”:基于飞书AILY实战的知识库泛化评测集构建指南

企业知识库为何总是'答非所问'?问题可能不在于AI模型本身,而是缺少一套科学的评测体系。本文揭秘如何利用飞书AILY智能体打造'三维一体'的泛化评测集,通过语义变异、场景噪声和逻辑陷阱的立体测试,让死气沉沉的知识库真正活起来。从数据清洗到智能扩增,再到闭环迭代,手把手教你搭建人机协同的知识进化引擎。

在数字化转型的浪潮中,我们见过太多“烂尾”的知识库项目:花大价钱接入了大模型,喂进去了成吨的PDF和Word,结果一线员工问一句“客户投诉物流延误怎么处理”,系统要么顾左右而言他,要么直接胡编乱造。

问题真的出在模型不够强吗?作为在信息化一线摸爬滚打多年的从业者,我的结论很明确:不是模型不行,是我们的“考卷”没出好。

大多数企业忽略了最关键的一环——知识泛化评测集。没有经过严格泛化测试的知识库,就像没经过路测的自动驾驶,上路就是事故。今天,我想结合最近团队利用飞书AILY智能体进行知识库重构的实战经验,抛开晦涩的算法公式,和大家聊聊如何构建一套能真正“测出深浅”的评测集,让企业的知识从“死库”变成“活脑”。

一、破局:为什么你的知识库“听不懂人话”?

很多信息化负责人在验收项目时,只盯着“标准问答”的准确率看。测试人员问“怎么报销”,系统答对了,就以为大功告成。可到了真实场景,员工问的是“差旅费发票丢了咋整?”、“周末加班的打车费能报吗?”,系统瞬间“失语”。

这就是典型的泛化能力缺失。传统的知识库是“关键词匹配”,而数智化时代的要求是“语义理解”。人类语言的组合是无限的,如果评测集里只有那几句干巴巴的标准问法,模型永远学不会如何应对千变万化的真实业务。

在引入飞书AILY智能体之前,我们团队也曾陷入“人工编写测试用例”的苦海,效率低且覆盖度极差。直到我们将评测集的构建逻辑植入AILY的工作流,才发现:构建评测集的本质,不是写题目,而是模拟真实的人类思维噪声。

我们需要模拟那些模糊的、口语化的、甚至带着情绪的提问,去“攻击”我们的知识库,找出它的边界。这不再是一个简单的测试环节,而是知识工程的生命线。

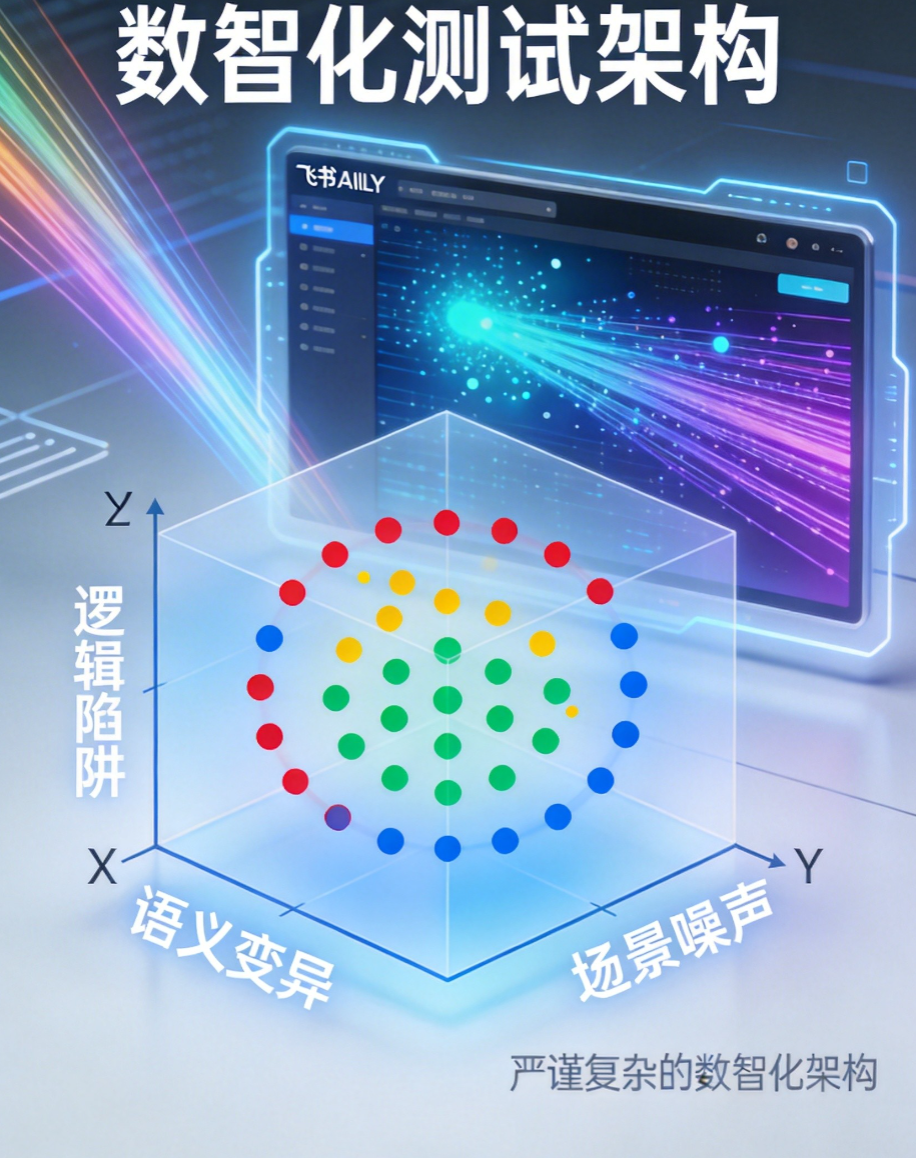

二、架构:基于AILY的“三维一体”评测数据矩阵

在飞书AILY的实践中,我们发现一套合格的泛化评测集必须包含三个核心维度:语义变异、场景噪声、逻辑陷阱。利用AILY的智能体编排能力,我们可以将这三个维度固化为自动化的生产流程。

1、语义变异层(Semantic Variation)

这是基础。针对同一个标准知识点(如“如何重置密码”),我们需要利用AILY的“文本生成”节点,基于大模型能力自动生成20-50种不同的问法。

- 同义词替换:“密码忘了怎么办”、“修改登录凭证”。

- 句式重组:把疑问句改成陈述句(“我想改密码”)、倒装句。

- 抽象与具体:从“系统登录问题”到“OA系统登不上去了”。

- AILY实践:我们在AILY中配置了一个“变体生成器”智能体,输入标准QA,它会自动调用大模型接口,按照预设的“口语化”、“专业化”、“简略化”风格批量产出变体。

2、场景噪声层(Contextual Noise)

真实世界是嘈杂的。员工提问时往往夹杂着背景信息、错别字甚至情绪。

- 口语化噪音:“那个,哎,就是我那个密码,好像过期了,咋弄?”

- 拼写错误:“密马忘咧”、“重致密码”。

- 多轮上下文:用户先问了“怎么登录”,接着问“那如果忘了呢?”。

- AILY实践:利用AILY的“代码执行”节点,我们写了一个简单的噪声注入脚本,随机在句子中插入语气词、制造常见错别字,并模拟多轮对话的历史记录,生成高保真的测试数据。

3、逻辑陷阱层(Logical Trap)

这是区分“人工智障”和“人工智能”的关键。

- 负样本:问一个知识库里根本没有答案的问题,检测系统是否会“幻觉”胡编。

- 冲突样本:当新旧制度冲突时(例如2025版和2026版报销制度不同),系统能否依据时间戳给出正确版本。

- 边界条件:“金额超过5万怎么批?”vs“金额正好5万怎么批?”。

- AILY实践:我们在AILY工作流中建立了“逻辑对抗”节点,专门生成这类刁钻问题,并预设了“拒绝回答”或“引用特定版本”的标准预期,用于自动化校验。

三、实战:飞书AILY驱动的人机协同流水线

有了理论框架,落地执行才是硬仗。传统的人工编写测试用例,耗时耗力。在我们的飞书环境中,通过AILY智能体,我们搭建了一套“人机协同(Human-in-the-Loop)”的自动化流水线。

第一阶段:种子提取与清洗(AILY + 多维表格)

我们从飞书客服机器人历史聊天记录、工单系统中,利用AILY的“数据读取”能力,自动提取高频问题和长尾问题,存入飞书多维表格。

- 关键点:特别关注那些“未解决”或“转人工”的工单,它们往往藏着知识库的盲区。AILY会自动标记这些“高风险”种子问题。

第二阶段:大模型辅助扩增(AILY智能体集群)

这是最核心的环节。我们构建了三个专用的AILY智能体:

- “挑剔员工”智能体:设定角色为“喜欢用口语、缩写、带情绪的一线业务员”,负责生成语义变异和噪声数据。

- “逻辑考官”智能体:负责生成负样本和逻辑陷阱题。

- “初审员”智能体:对生成的数据进行初步去重和格式检查。

- 操作流:只需在飞书群里@一下“评测集构建助手”,输入业务领域(如“财务报销”),几分钟后,一个包含数百条高质量测试用例的多维表格就自动生成好了。

第三阶段:专家校验与金标确立(飞书审批+多维表格)

机器生成只是初稿,业务专家的审核才是灵魂。

- 我们将AILY生成的数据推送到飞书审批流,分发给各领域的业务专家。

- 专家只需在移动端点击“通过”或“修正”,并标注标准答案和难度等级(L1-L4)。

- 修正后的数据自动回流到多维表格的“金标库”,成为下一次模型训练的基石。

这套基于飞书AILY的流水线,将我们评测集的构建周期从一个月缩短到了三天,且覆盖率提升了300%。更重要的是,这个过程本身就是在梳理业务逻辑,很多陈旧的制度漏洞也在这一过程中被业务专家发现并修复。

四、演进:让评测集成为知识进化的“发动机”

评测集建好了,是不是就万事大吉了?恰恰相反,这只是开始。

在数智化时代,知识库不是静态的仓库,而是动态生长的有机体。基于飞书开放平台的能力,我们建立了一套**“评测-反馈-迭代”**的闭环机制:

自动化回归测试(CI/CD for Knowledge) 每次知识库更新文档、或调整AILY智能体的提示词(Prompt)前,触发飞书自动化流程,全量跑一遍评测集。任何一项指标(尤其是逻辑陷阱层的通过率)下降,飞书机器人会立即在项目管理群发出预警,驳回发布。

坏案驱动学习(Bad Case Driven) 线上运行中,凡是用户在飞书对话框里点了“踩”、或者点击了“转人工”的问题,AILY会自动捕获这些会话,将其标记为“待分析”,并每周定期将这些新案例转化为新的测试用例,补充进评测集。让每一次失败,都成为系统进化的养分。

动态难度调整 随着模型能力的提升,原本属于L4的难题可能变成了L2。我们利用AILY定期重新标定难度,并引入更复杂的边缘案例,保持评测集的“挑战性”,防止模型“躺平”。

对于信息化管理者而言,这套机制的价值在于可量化的治理。以前我们说“知识库不好用”,现在我们可以基于飞书仪表盘说:“在L3级复杂场景下,我们的泛化召回率只有65%,主要卡在跨文档推理环节,建议优先优化财务域的文档结构。”这种基于数据的决策,才是推动企业数字化转型的根本动力。

结语

构建知识泛化评测集,是一场技术与业务的深度联姻。它不需要你精通每一个算法细节,但需要你深刻理解业务的痛点,拥有对数据质量的洁癖,以及善用工具(如飞书AILY)的智慧。

在2026年这个节点,让我们不再满足于做一个“存储者”,而是成为企业智慧的“炼金术师”。用科学的评测体系,去伪存真,让每一分知识投入,都能转化为实实在在的生产力。

这条路或许充满挑战,但风景独好。共勉。

本文由 @数智产研笔记 原创发布于人人都是产品经理。未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益